AI在图形创作中的法律问题 i-Legal分析

尽管生成用户请求的视觉内容的AI服务的受欢迎度迅速增长,但从法律的角度来看,它们的运作(以及使用它们生成的图形)引发了许多问题。在App2Top的特别材料中,来自i-Legal的律师回答了最相关的问题。

作者:娜塔莉亚·尤尔科娃,i-Legal公司的管理合伙人,阿列克谢·科诺诺夫,i-Legal的首席律师,以及玛丽亚·奥尔多夫斯卡娅-塔那耶夫斯卡娅,i-Legal公司企业部门顾问。

娜塔莉亚·尤尔科娃、阿列克谢·科诺诺夫和玛丽亚·奥尔多夫斯基-塔那耶夫斯基

我是一只颤抖的生物,还是我有版权呢?

在2022年,似乎每个人都能看到在中国神经网络QQ上制作的宠物动漫版本,或者通过Midjourney进入充满赛博朋克色彩的哈利·波特世界。

由神经网络生成的图片迅速“病毒式传播”,实际上让我们成为生成性人工智能(generative artificial intelligence;英文“generative”意为“生成”的)学习机制的一部分,这种机制不仅可以分析数据,还可以生成数据。

“盒子里有什么?”

如今,当提到将文本转化为内容(text-to-content generation)的生成性AI时,通常指的是DALL-E 2(OpenAI开发;生成逼真的图像)、Midjourney(独立实验室开发;通过Discord中的机器人访问;具有自己独特的风格,并可以模仿艺术家的风格;有试用版,默认是收费的)或Stable Diffusion(由初创公司Stability AI开发的开源模型;通过付费服务Dream Studio或第三方应用程序提供,或以用户设备上的免费版本提供)。

按下“/imagine”开始

为了通过神经网络生成内容,用户输入文本(即所谓的提示;来自英文“prompt”意为“提示”),AI将其转化为图像。

在提示中,可以指定相当基本的内容:物体、颜色、艺术风格。当然,也可以设定更专业的参数,例如焦距、色差或参考特定的“引擎”,例如Unreal Engine。

一个提示和由该提示生成的图像示例:

“一个穿着长尘土飞扬的黑色大衣和扁平帽子的人骑着一匹在后末日城市废墟中行走的黑马,朝着地平线上的日落骑去,荒凉的景象,阴郁的气氛,超现实主义,风景摄影,超广角,景深,超详细,美丽的色彩,疯狂的细节,美丽的色彩分级,快门速度1/1000,F/22,白平衡,4K,8K,RTX渲染,超级分辨率,孤独,完全上色,柔光,色差 — Variations by @9664989620 (fast)”

图像和提示来自Discord中的Midjourney机器人。Variations by @9664989620

提示用于高效指导AI。根据其设计,提示可以相当复杂,但它们实际上是一组单独的词,虽然是按照一定的原则组成的。因此,和“推特”不同,难以设想一个提示会成为一个独立的版权对象。然而,由于某些条件下,类似的提示组合可以与数据库相比较,因此可能会受到法律保护。

至于在提示中使用艺术家或角色的名称作为参考,提示中提到的事实,例如艺术家列昂尼德·阿弗列莫夫(其风格相当独特),不应构成侵权行为,但这样得到的结果可能会存在问题。这是为什么呢?我们试着分析一下。

“从一百只兔子里永远不会变成一匹马,从一百个怀疑中永远不会得出证据”

生成性AI通过识别所提供数据中的模式进行学习和再现。用于将文本转化为图像的AI的训练需要视觉材料,而这些材料通常是受保护的智力成果。换句话说,未经权利所有者许可,使用网络上的图像并不总是合规的。

目前,AI在受著作权保护的图像上“学习”的可能性基于公正使用(fair use)原则,该原则在美国和英国普遍适用,在特定情况下允许在未经作者同意的情况下使用受著作权保护的作品,包括图像。

在评估是否发生公正使用时,法院考虑以下参数(以1976年美国著作权法为例):

1. 使用的目的和性质(原作如何被利用,以及使用是否商业化)

为了使使用数据被视为非商业性,必须是研究者和非营利组织创建的数据和模型。公司力求符合这些标准:Stable Diffusion根据LAION数据库(一家德国非营利组织)使用数据,而该公司没有收集数据或进行模型训练(正因如此,Stable.AI能够出售高级访问权限);DALL-E 2同样是由非营利组织OpenAI开发的(其主要合作伙伴和投资者是微软)。

但是,上述情况下被称为“AI数据洗钱”的做法,已经在形式上引发了遵循公正使用原则的疑问。因此,明确判断法院是否会认为使用真的是非商业性的,确实非常困难。

2. 受版权保护作品的性质(该作品在激励创造的版权目的中所占的地位,其性质是创造性还是主要事实性的)

对LAION-5B中的数据超过1200万张图像的研究(用于训练Stable Diffusion)显示,其中47%的图像来源于仅100个域名,例如Pinterest或DeviantArt。然而,图像来自授权网站的事实并不意味着这样的域名是图像的原始来源或其使用是被允许的。例如,通过一个工具,可以检查在数据中是否包含某些艺术家的作品,发现了一些曾在RedBubble商店中被删除的图像。

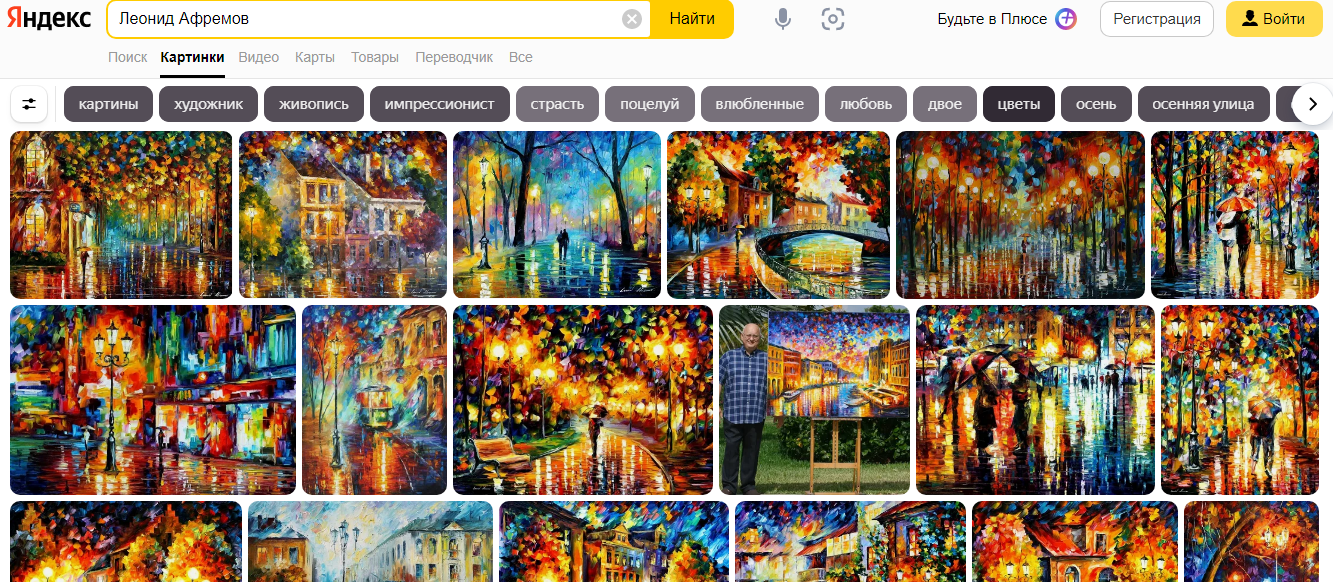

此外,可以间接判断AI是否学习了某位艺术家的作品。例如,Midjourney对包含“列昂尼德·阿弗列莫夫”之词的提示的反应表明,该网络对其有所了解:

Midjourney根据提到的列昂尼德·阿弗列莫夫风格生成的图像

因此,高度可能,依据这一标准,使用受版权保护图像的AI行为将支持原创作品的作者。

3. 对受版权保护作品的使用量及其对最终结果的重大性

生成的AI图像看起来是独创的,专门为特定提示而制作。然而,最近针对Stable Diffusion进行的研究表明,技术上可以确定生成内容在多大程度上“复制”了训练时所用的图像(英文称为replication),并确定原始图像。

对该标准的符合性需逐案评估。是否采用技术标准并依据数量指标(如上述研究所示),或是更加“主观”的从人之角度判断(例如对某一图像的认知),都难以预测。

4. 这种使用对原作价值的影响(是否对原作的潜在市场造成损害,及损害的程度,例如是否会成为替代品)

该标准是评估公正使用中最复杂和最重要的标准之一。但是与已有的实践进行类比相当棘手,至少因为并不完全清楚哪些具体行为会被法院视为可能造成艺术家最为担忧的情况 - 贬值他们的创作及多年来积累的技巧和风格。

应追责的究竟是那些创造这一“大规模‘智能创意’武器”的公司,还是那些可能利用这一武器伤害艺术家的“普通用户”?不幸的是,目前对此问题的答案更多的将取决于道德而非法律。

“问题。问题需要答案”

如果AI在受版权保护图像上的训练被认定违法公正使用原则的可能性相对较小(因为它符合上述标准),则内容的创建和后续使用过程则引发了大量问题,并需要引入更具体的监管措施,以回答谁有权以及如何使用生成的图像。

目前,该领域的监管在公共层面上限于其时代的技术,公司试图自我限制(或免除潜在责任),在其许可协议中赋予用户某些权利。

根据Midjourney服务条款,未购买付费订阅的用户获得的是Commons Noncommercial 4.0 Attribution国际许可证。根据该许可证,用户可以通过传播、公开展示等方式使用图像,但不得用于商业目的。此外,用户不能禁止任何其他人使用根据他们的提示生成的作品。实际上,Midjourney作为一个协作工作空间,其他人可以使用他人的提示或生成的图像。

如果用户选择付费套餐,他们将成为生成的图像及其他资产的完整所有者。然而,通过公开渠道(例如Discord聊天)生成的任何图像均可供第三方查看。

用户可以为其订阅购买额外的隐私选项(privacy add-on),Midjourney承诺尽一切努力不公布用户创造的作品,亦即用户可以创建一个类似私人的作品生成频道,从而进行商业化使用。

Midjourney的创始人还指出,模型生成结果时使用的AI系统是建立在公开数据的基础上,所获得的结果可能与受版权保护的材料或商标相似,公司愿意考虑与潜在侵权相关的请求。

而另一方面,Stable Diffusion在Creative ML OpenRAI-M的许可证下发布,允许用户:

- 复制、公开展示、公共表演、再许可以及分发模型及其所有附加材料,例如源代码和任何衍生模型;

- 以商业方式使用模型及任何附加材料;

- 保留使用模型创建的输出的数据的权利。

此外,Stable Diffusion 表示,艺术家将具有选择将哪些作品从用于训练Stable Diffusion 3模型的数据中排除的权利。同时,艺术家们认为,作者的一致同意应以明确的方式呈现,而不是“默许”。

因此,ArtStation(专业艺术家网站)上开启了罢工,反对使用生成AI的内容。现在,标记为NoAI(不使用AI)的项目将自动贴上HTML元标签NoAI,禁止AI系统使用该内容。

根据ArtStation服务条款,网站上发布的所有作品均属于艺术家,ArtStation不会将作品出售或许可给其他公司。此外,条款禁止“收集、聚合、提取、删除或以其他方式使用任何上传到网站的内容,以便测试、输入或将该内容与人工智能或其他算法方法整合使用,当该内容被标记为NoAI时”。

一些作者以更明显的方式表达他们的异议:在加利福尼亚联邦法院提起了针对微软、GitHub和OpenAI的诉讼(目前尚未审理)。该诉讼涉及GitHub Copilot算法的工作,该算法由OpenAI和GitHub(隶属微软)共同开发,并由微软使用该公司的许可证。

在编写代码的过程中,算法提供结束字符串的建议,并且已经宣布了一个新功能,可以将已准备好的代码块添加到代码中。原告声称,Copilot在复制开源代码时未指出作者,而该开源代码的许可证明确要求这么做。此外,诉讼还指称存在违反DMCA的行为,即删除有关版权的信息。

“得出了。输出。出色的输出!”

对用户和网络而言(尤其在公正使用原则的背景下)最重要的问题是算法工作的“生成”阶段,即从用户的提示… 嗖的一声! – 生成出图像的过程。

首先,要考虑的是,从监管和潜在侵权的角度,应该归属哪种司法管辖权,考虑到“去中心化”的AI网络和被认为是“侵权者”的主体尚未确定?由于在这一方面的认知和其他方面的理解同样有限,不幸的是,目前只能依赖于公开的信息来源,其中大部分指向美国和英国的立法,尤其,这些国家是与相关公司有联系的地方。

在美国,纯人工生成的作品不受到版权保护。只有在证明人类已作出实质性贡献的情况下,才会出现法律保护。根据美国版权局(USCO)的观点,根据1976年美国著作权法,作品的作者只能是人,而AI不符合该要求。因此,博士斯蒂芬·塔勒(Stephen Thaler)提出了注册一件AI创作的艺术作品的申请,申请中他将自己列为权利持有人,而将AI创造者机器列为作者,USCO拒绝了他的申请,目前他正尝试对此进行上诉(Stephen Thaler v. Perlmutter and The United States Copyright Office)。

因此,值得特别注意的是,某件AI创作的图像为其作者赢得了一个奖项,他在经历了80小时的时间和900次迭代后,将作品“空间歌剧院”呈现于比赛,同时对AI生成的图像进行了在Adobe Photoshop中的改进。

同样在美国,注册了一部漫画书的版权,该书是通过Midjourney生成的。艺术家克里斯·卡什塔诺娃(Kris Kashtanova)在封面上明确指出了图像的来源。

英国是为数不多提供纯计算机生成作品的版权保护的国家之一。根据英国法律,作者是“采取必要步骤以创作作品的人”。对此解释似乎可以有多种解读(这“人”是模型的开发者,还是仅仅是使用者?)。

作为商业化的一种方式,生成的AI图像可以在库存平台上发布。然而,在这一领域的大型参与者中并没有统一的观点关于此类图像的合法性:

- Getty Images禁止使用AI生成的图像,指出销售AI艺术作品可能对用户构成法律风险;

- Shutterstock与OpenAI签订了整合DALL-E的协议;与此同时,曾用作训练模型的艺术家将获得赔偿;

- DeviantArt宣布将用户内容用于训练AI,但在随后的反对声中撤回该决定;

- Adobe Stock承认使用AI生成的内容,但需遵循一些规则,例如图像标题必须包含“生成性AI”的标注。

在Adobe的政策中,内容的责任由用户承担:

- “…你向我们保证,你在Adobe Stock上使用内容的所有权利,内容不侵犯任何第三方的权利”;

- “切勿上传侵犯第三方权利的内容,包括模仿或复制内容或风格”;

- “在没有权利的情况下,不得将某个图像作为生成AI提示的参数”。

“安娜已经买了葵花油,而且不仅仅是买了,甚至还倒了”

对生成性AI的训练过程无法逆转,无法强迫网络忘记列昂尼德·阿弗列莫夫的画作。要么毁掉模型(考虑到Stable Diffusion作为开源项目的普及,这似乎已不太可能),要么采取相应的监管措施。

不幸的是,此类监管的实施速度未能跟上AI发展的速度,而最复杂的问题不在于版权领域,而在于更为微妙的伦理和道德领域。

在当前缺乏监管的情况下,如果希望创建、发布或使用利用AI获取的材料,只能建议仔细研究现行服务条款,咨询法律专家,并心理准备面对这一快速发展领域中可能出现的意外“情节”转折。