神经网络是一种工具,而不是魔法按钮。ZiMAD谈论与人工智能合作进行手机游戏图形设计的经验

如何与人工智能找到共同语言,以及在不降低质量的情况下,实际上可以将工作委托给神经网络的哪些部分,— 这是公司 ZiMAD 的艺术家安德烈·诺维科夫在他的专栏中为 App2Top 讲述的。

安德烈·诺维科夫

当我刚开始做设计师时,市场上的软件少得多,功能也有限。

今天 — 一切都变了。例如,一些解决方案可以将单调的工作降到最低。

但这也有反面效果,软件变得更难掌握。因此,必须不断学习,掌握新的内容。

现在,在我的工作中,我主要使用 Photoshop 与内置的人工智能和 Stable Diffusion 的组合。

我开始学习后者是通过网上的手册。一年前,如果没有弄清楚这些手册,甚至连安装和设置神经网络(没有现成的包)都无法做到。最后,我甚至还参加了一个关于 Stable Diffusion 的培训课程。

我是否建议别人也这样做?

绝对是的。如果有机会向那些已经掌握这一主题并愿意分享经验的人学习,那么一定要抓住这个机会。课程可以将学习时间从两周缩短到两天 — 提供所有的路径和技巧,以及基本知识,掌握这些,您就可以立即开始使用软件。

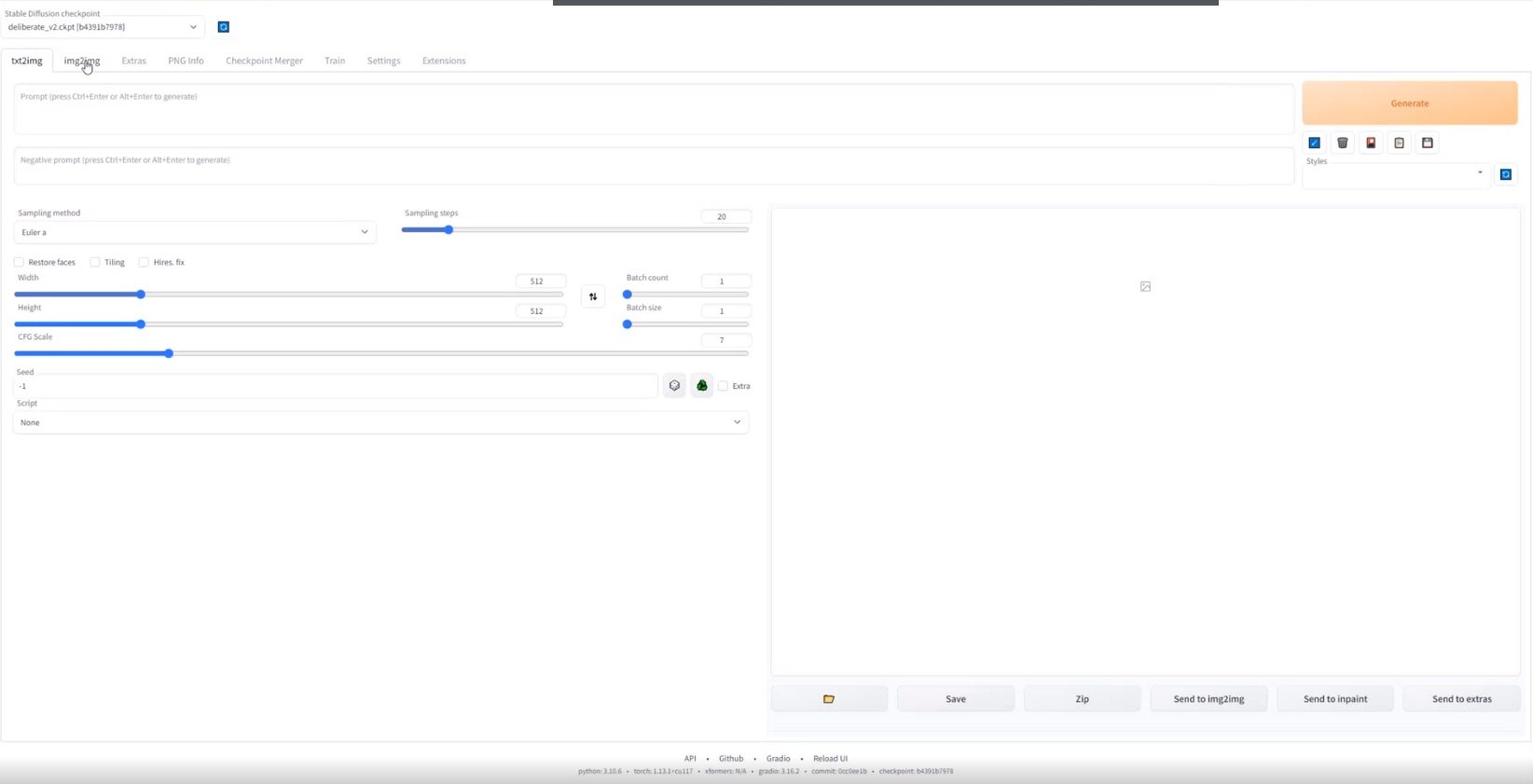

Stable Diffusion 的设置是在本地计算机上进行的 — 安装 Python,启动编译器,接下来获得链接,通过这个链接打开网络界面。

Stable Diffusion 的特点在于其设置的多样性。使用它时,必须知道哪些设置及其作用。这不同于 Photoshop 中那些可以通过图标猜测功能的常规按钮。

但用户也可以使用其他接口,这是特定用户的选择。其他选项包括 Easy Diffusion、Vlad Diffusion、NMKD Stable Diffusion GUI。

神经网络几乎瞬间就能产生结果 — 这不是渲染,您可以在等待时去厨房喝咖啡,或与同事在饮水机旁聊几句。但是,为了与人工智能快速合作,重要的是要将一切设置好。

训练人工智能

与神经网络“按部就班”的工作是学习的结果。

例如,我需要神经网络能够生成符合我风格的室内设计。为此,我做了以下几件事:

- 拿了一张 ZiMAD 项目(Puzzle Villa)的图片;

- 将所有图片剪切成小块,以便每个片段中都有一个室内元素;

- 请神经网络描述它在图片中看到的内容(在这一步中,重要的是评估数据的正确性并根据需要进行纠正;如果不这样做,在后续工作中,神经网络将坚持产生错误的生成结果;例如,如果它将柜子误认为一个人,那么在请求生成柜子时,它就会输出一个人);

- 在对神经网络进行训练后,得到了所需的风格。

顺便说一下,这种风格可以传递给同事以实现最终图像的最大一致性。他们只需拥有一个关键 — 背景。

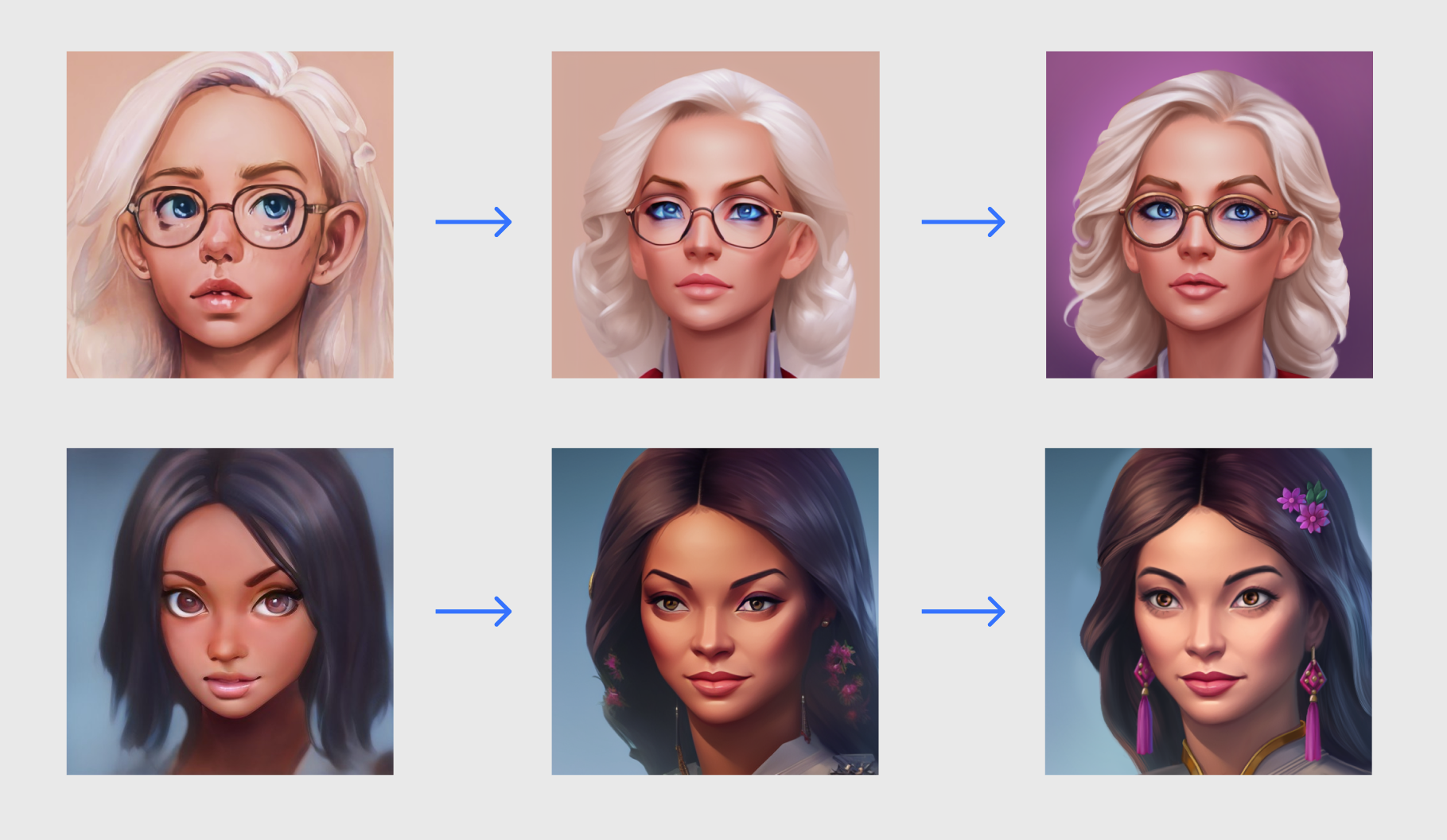

最终,我与人工智能的工作归结为三个阶段:

- 给神经网络展示50+张图片,描述并获得新风格;

- 将需要修改的图片传送通过风格处理;

- 得到的图片由插画师进一步修改(添加或删除细节)。

1 — 原始图像;2 — 经过风格处理的图像;3 — 已由插画师修饰的图像。

提示 — 与人工智能互动的关键

如果您想从神经网络获得高质量的结果,那么您需要练习使用提示,即文本请求。最终结果取决于它们的表述方式。

每个提示都是独特的,任何小细节,包括所使用的单词顺序,都可能影响图像。

但是,我不推荐仅使用提示。与神经网络可以互相转发图片。对我来说,这比用文字解释所有内容简单。例如,假设我需要基于特定的猫生成一张图片。

我插入猫的图片,写下我想要的内容,比如「给猫戴上帽子」。但是,在第一次请求时,人工智能提供所需结果的可能性几乎为零。为了加快过程,我在 Photoshop 中先勾勒出帽子的草图。

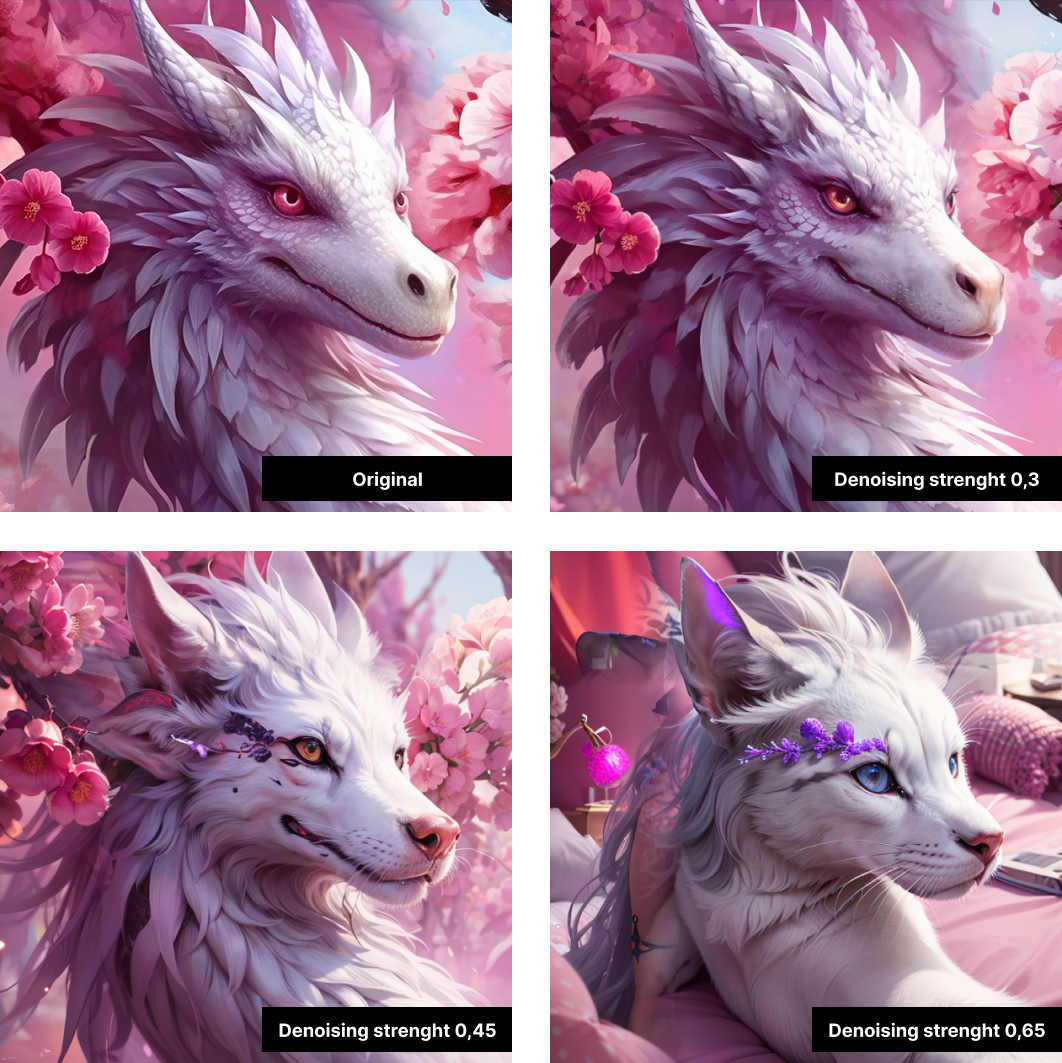

然后,在人工智能界面中,我选择需要神经网络处理的区域(inpaint工具),并设置所需的参数 — 变体数量、详细程度,以及最重要的,去噪强度,决定神经网络将如何遵循我的草图(其中0不会进行任何修改,而1.0会完全忽略我的草图,自由绘制)。

接下来,我得到了几种我想要的猫戴帽子的变体,并选择了我满意的选项。

这里还有一个例子,展示了神经网络如何加速艺术家的工作。

一位2D艺术家需要为一个活动创作独特的用户界面。他做了草图,我将其通过神经网络处理,并在提示中补充了艺术家的所有要求。结果,我们几乎瞬间就得到了很好的基础进行进一步修改。

重要的是:插图中的苹果箱、楼梯和羊是单独生成的。这是为了获得更可预测的结果和后续灵活的修改。

另一个非常强大的方向是3D。目前我有生成小空间的任务。神经网络在室内设计方面表现良好,但在生成时总是跳动透视,而我需要特定的视角。这个问题我用 ControlNet 通过几个简单步骤解决。

第一步。我在 3D 中建模场景,放置场景中的对象,设定相机,渲染深度图,并得到这样的图像。

第二步。我将深度图上传到 ControlNet,设置参数,以便神经网络基于这张深度图像生成图像,保持视角和对象位置。接下来,在提示中说明,人工智能必须输出一个阴暗、凌乱的阁楼,窗子在屋顶中间,中央有一个纸箱。获得以下图像。

此后,我根据技术要求在图形编辑器中完善氛围。应该得到一幅悲伤的小猫图像,它在暴风雨的夜晚,躲在阁楼中请求帮助。我得到了这幅可以交给动画师进行后续工作的图像。

人工智能对艺术家的价值

神经网络是一个工具,帮助建立可以随意打磨的基础。简而言之,多亏神经网络,艺术家们有了更多时间专注于图像的精细处理,而不是技术性工作。

在一两年前,当我被分配任务画20个头像时,制作过程会是这样的:

- 寻找参考资料;

- 准备草图;

- 从零开始绘制每个头像;

- 修饰每个头像。

今天,神经网络承担了大部分工作,大幅缩短了用于常规任务的时间。

如果项目风格已经准备好,那么生成一个游戏头像可能只需5-7分钟。在这段时间内,我可以选择20-30张图片。生成十个头像同样数量的变体大约需要一个小时。

借助人工智能的力量,我可以单独完成比以前更多的任务。因此,这是一种很好的工具。确切地说,这是一个工具,而不是一个神奇的按钮,声称将剥夺艺术家的工作。

神经网络之间相辅相成。例如,Stable Diffusion 在休闲图形上效果更佳,而 Photoshop 的神经网络在处理真实图像时表现出色。然而,结果并不像 Stable Diffusion 那样可预测,因为没有更多的设置,这由便捷的界面所弥补。

比如,如果有一张有趣的图片,裁剪起来不方便,那么可以直接在 Photoshop 中补充缺失的部分。这个过程轻松迅速。在 Stable Diffusion 中,虽然可以获得同样的结果,但需要多花一些努力。

Midjourney 能够生成美丽的奇幻图像,但不幸的是,其分辨率有待提高。因此,在 ZiMAD,我们将 Midjourney 与 Stable Diffusion 结合使用,以提高分辨率。好处在于,可以保持图像不变,仅提高分辨率或根据需要添加细节。

例如,一位同事利用 Midjourney 为 Magic Jigsaw Puzzles 制作了一张美丽的图像,而我通过 Stable Diffusion 将其分辨率提升到 4k。

在此过程中,我使用了 Script 字段,选择了我们这个案例中的 LDSR 放大器,设置放大因子参数,该参数决定图像将被放大多少倍,同时记得将去噪强度参数设置在接近最低的值(如果设定值过高,神经网络会严重重绘图像,在我们的例子中,放大值应在0.1-0.2之间)。

如果找到了合适的去噪参数,神经网络只会补充细节,而不会大幅改变图像。例如,这样,狼的毛发变得更加细腻,像素感消失了。

使用 Stable Diffusion 当然也有缺点。建筑和文字仍然很难处理,建筑物可能显得杂乱无章,而文字则完全无法阅读。

但我相信,随着时间的推移,这些缺点会得到解决。

尽管在使用神经网络时会出现困难,艺术家和游戏团队今天就需要学习如何与之合作。否则,他们在市场上几乎无法保持竞争力。

例如,现在我面临的任务是准备50个图标。手动创建它们可能至少需要一周时间。而借助神经网络,这个任务可能不会超过两天。

因此,最好不要抵抗新技术,而是学习如何与之有效互动。